仕事や学習でAIを日常的に使っていると、自分で考える量が減って思考停止に陥っているのではないかと不安を感じる人が増えています。

AIの利便性を享受しつつ健全な関係を築くためには、AI依存の仕組みを理解し、主体的な意思決定を取り戻す具体的な運用ルールを設ける必要があります。

人間の認知機能は負荷を避ける性質があり、解答を即座に提示するツールを無批判に使い続けると、思考力や自己効力感が低下するリスクを伴うからです。

本記事のチェックリストや活用テンプレートを実践すれば、AI依存状態を脱却し、思考力や自信を保ちながら生産性を高める本来の効率化を実現できます。

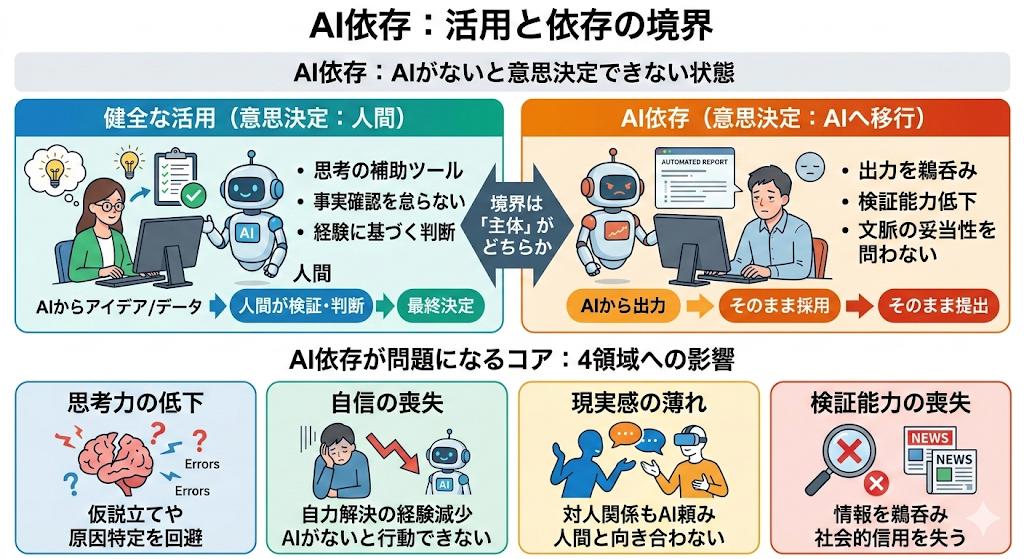

AI依存とは「AIがないと意思決定できない状態」

ツールを使いこなしながら思考力を維持している人と、出力に振り回される人には明確な違いが存在します。

その違いとは、情報の真偽を自分で検証する仕組みを持っているかどうかです。

依存の問題は、意思決定の主体が人間からツールへ移行してしまう事態を指します。

原因を正しく把握し、自己の行動への影響を客観的に評価しましょう。

本セクションでは、以下の2つの観点からAI依存について詳しく説明します。

- 依存と活用の境界

- 依存が問題になるコア

依存と活用の境界

AIを健全に活用している人は、最終的な意思決定の主体を自分自身に置いています。

AIはあくまで思考を補助するツールであり、完璧な解答を提供する存在ではないと認識しているからです。

例えば企画書を作成する際、健全な活用者はAIに複数のアイデアを出させますが、ターゲット層に合致するかどうかの判断は自身の経験に基づいて行います。

情報の事実確認を怠らず、必要に応じて一次情報を確認する手間を惜しみません。

一方でAI依存状態にある人は、出力された内容を疑わずにそのまま提出してしまいます。

出力結果の真偽や文脈の妥当性を自力で検証する能力が低下している状態です。

したがって、AIに依存せずに活用するためには、出力結果に対して常に人間の視点で評価を加える工程が不可欠です。

依存が問題になるコア:思考・自信・現実感・検証の4領域

AI依存が深刻な問題を引き起こすのは、人間の認知機能である思考力や自己効力感を奪うからです。

瞬時に答えが出る環境に慣れると、仮説を立てて検証するプロセスを脳が回避するようになります。

例えばプログラミング学習でエラー修正を完全にAIへ任せると、原因を特定する思考力が育ちません。

自力で課題を解決した経験が減り、AIがないと行動できないという自信の喪失につながります。

対人関係の相談までツールに頼りきりになると、人間と向き合う現実感が薄れる危険性を伴います。

情報を鵜呑みにするリスクも高まり、社会的な信用を失う結果を招きかねません。

このように、思考、自信、現実感、検証能力の4領域において、過剰な依存は深刻な悪影響を及ぼします。

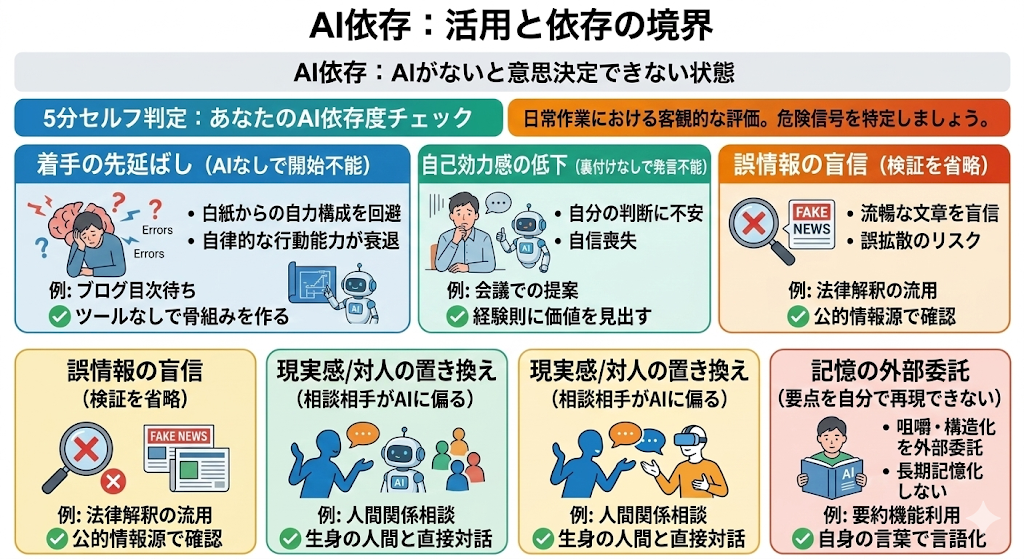

5分セルフ判定:あなたのAI依存度チェック

日常の作業において、ご自身がAI依存に陥っていないかを客観的に評価します。

自覚のないまま進行し、意思決定の能力が低下しているケースは少なくありません。

以下の項目に当てはまる場合は、ツールとの関わり方を見直す必要があります。

仕事や学習で、AIがないと行動が停止してしまう状態は危険信号と言えます。

ご自身の思考を振り返り、人間の役割をツールに丸投げしていないか確認しましょう。

各項目は、人間の認知機能や心理状態の変化を具体的に表しています。

当てはまる症状を特定し、早期に対策を講じましょう。

- 着手の先延ばし

- 自己効力感の低下

- 誤情報の盲信

- 現実感と対人の置き換え

- 記憶の外部委託

着手の先延ばし(AIがないと開始できない)

タスクに取り掛かる際、AIの出力がないと第一歩を踏み出せない状態は深刻なAI依存の初期症状です。

白紙の状態から自力で構成を練るという、最も認知負荷のかかる作業を完全に回避する習慣がついているからです。

例えばブログ記事を執筆する際、AIに目次を作成してもらわないと文字を書き始められない状況が該当します。

自力でアイデアを絞り出す苦労を経験しないため、自律的な行動を開始する能力が徐々に衰えていきます。

システム障害などでツールが利用できない状況に陥ると、作業が完全にストップしてしまいます。

自分の頭で考えてからツールを使うという、本来の正しい順序が逆転してしまっている状態です。

したがって、ツールなしで自力で作業の骨組みを作る習慣を取り戻すことが、依存解消の第一歩となります。

自己効力感の低下(裏付けがないと発言できない)

自身の意見や判断に対してAIの裏付けがないと、不安で発言できなくなる状態は危険な兆候です。

自分の知識や経験よりも、機械が生成した文字列を無意識に高く評価してしまっているからです。

例えば会議で提案を行う際、事前にAIへ入力して高評価を得られないと、自信を持って発言できないケースが挙げられます。

専門的な業務においても、自分の蓄積したスキルを信じられなくなり、判断をツールへ委ねるようになります。

自己判断を避ける行動を繰り返すことで、主体的な意思決定を行う心理的なハードルが上がり続けます。

他者とのコミュニケーションにおいても、正解を気にして委縮する原因となります。

ゆえに、自分自身の経験則に価値を見出し、単独で意見を構築する自信を回復させる必要があります。

誤情報の盲信(検証を飛ばす)

AIが出力した情報を疑うことなく、事実関係の確認を飛ばして利用する行為は深刻な問題です。

流暢な文章で断定的に出力されるため、脳が正しい情報であると錯覚しやすい性質を持つからです。

例えば法律の解釈を調べる際、回答をそのまま企画書に記載して間違いが発覚するケースが該当します。

もっともらしい嘘を識別する能力は、日々の検証作業を通じてのみ維持されます。

情報を自ら疑い、複数の一次情報源にあたって裏付けを取るプロセスを省略する癖がついています。

誤情報を拡散してしまうと、組織全体の信用問題に発展する大きなリスクがあります。

そのため、出力されたデータは必ず外部の公的な情報源で真偽を確認するフローを徹底すべきです。

現実感/対人の置き換え(相談相手がAIに偏る)

悩みの相談相手をAIに限定し、人間とのコミュニケーションを避ける状態は不健全なAI依存です。

AIは基本的にユーザーの意見を否定せず、肯定的に返答を行うからです。

例えば人間関係で悩んだ際、同僚に相談せず、チャットボットに慰めの言葉を求め続けるケースが当てはまります。

自分を全肯定するツールとの対話に慣れると、意見が対立する人間との対話を面倒に感じ始めます。

多様な価値観に触れる機会が失われ、狭い視野の中で物事を完結させる思考回路が固定化されます。

複雑な人間関係から逃避し続けると、実社会における問題解決能力そのものが低下してしまいます。

したがって、感情的な相談や悩みは、生身の人間と直接対話して解決の糸口を探る行動が不可欠です。

記憶の外部委託(要点を自分で再現できない)

学習のポイントをAIに任せきりになり、自分の言葉で内容を再現できない状態は深刻な問題です。

情報を定着させるために必要な、内容を咀嚼して構造化する認知プロセスを外部へ委託しているからです。

例えば長文を読む際、要約機能の箇条書きを見るだけで、内容を理解した気分になるケースがあります。

要点を抽出し、記憶に結びつける作業を怠るため、新しい知識が長期記憶として定着しません。

議事録作成をツールに依存し、決定事項の背景を自分の言葉で説明できなくなるのも同様の現象です。

情報を通過させているだけの状態に陥り、自身の専門性を高める重要な機会を喪失しています。

ゆえに、学習内容や重要な事項は、必ず自分の頭で反芻し、自身の言葉で言語化する習慣を維持すべきです。

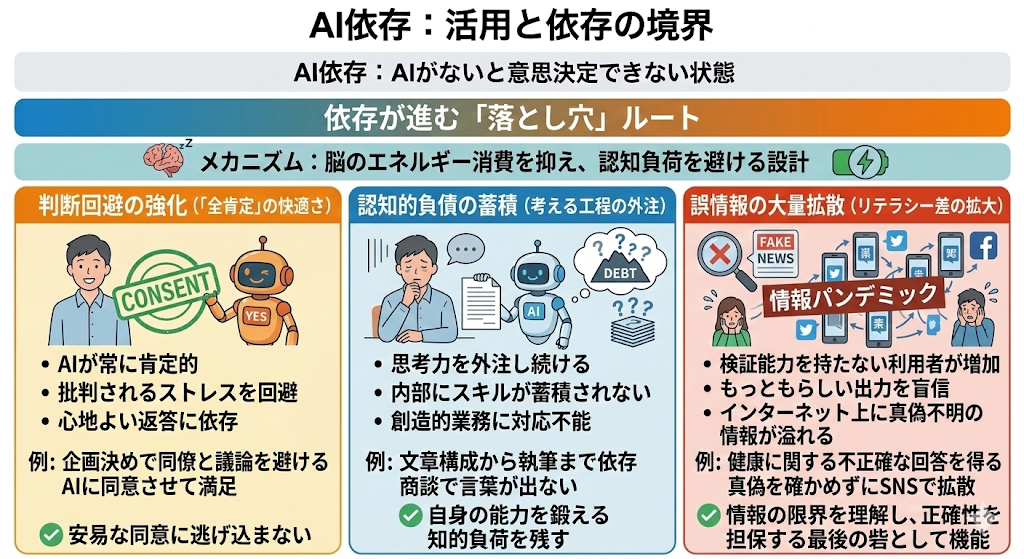

依存が進む「落とし穴」ルート

利便性に惹かれ、気がつかないうちにAI依存を深めてしまうメカニズムを解説します。

人間の脳はエネルギー消費を抑え、認知的な負荷を避けるように設計されています。

ツールが提供する即座の解答は、脳にとって極めて快適な体験をもたらします。

この快適さが罠となり、自ら思考し判断する工程を回避する習慣が形成されます。

依存の進行は個人の能力低下にとどまらず、社会全体へ悪影響を及ぼします。

どのような経路を辿るのか、具体的なプロセスを理解しましょう。

以下で、依存を加速させる三つの落とし穴を見ていきます。

- 判断回避の強化

- 認知的負債の蓄積

- 誤情報の大量拡散

“全肯定”の快適さ→判断回避が強化される

AIが常に肯定的に応じる特性は、人間の自己決定能力を奪う危険性を孕んでいます。

人間は反論を受けるストレスを嫌い、自分の意見を無条件に受け入れる環境へ依存しやすいからです。

例えば企画を決める際、同僚と議論して批判されるのを避け、AIに同意させて満足する行動が該当します。

ツールは正確性よりも、入力内容に沿った心地よい応答を生成することを優先する傾向があります。

心地よい返答を得る経験を繰り返すと、他者と意見を戦わせて最適解を導き出す耐性が失われます。

正解のない複雑な問題に対して、最終的な判断を下すこと自体を極端に恐れる心理状態へ陥ります。

そのため、全肯定はプログラムされた応答であると認識し、安易な同意に逃げ込まない姿勢が必要です。

認知的負債:考える工程を外注し続けた副作用

思考するプロセスをAIへ外注し続けると、長期的には認知的負債として自身に重くのしかかります。

人間の脳は筋肉と同様に、継続的に負荷をかけて使わなければ情報処理能力や思考力が衰退するからです。

例えば文章の構成から執筆までを依存していると、商談で論理的に話すよう求められた際に言葉が出なくなります。

手軽に成果物を得て短期的な生産性は上がったように見えても、内部には何のスキルも蓄積されていません。

思考力の低下という借金は膨らみ続け、ツールが使えない環境下で能力不足として顕在化します。

創造的なアイデアの創出といった、人間にしかできない高度な業務に対応できなくなってしまいます。

したがって、プロセスすべてを自動化せず、自身の能力を鍛えるための知的負荷を意図的に残すべきです。

誤情報の大量拡散:リテラシー差が誤情報を拡大する

AI依存が社会規模で進行すると、誤情報が爆発的に拡散する情報パンデミックを引き起こす危険性があります。

生成される情報に対する検証能力を持たない利用者が増え、誤った内容が事実として流通してしまうからです。

例えば健康に関する不正確な回答を得たユーザーが、真偽を確かめずにSNSで拡散してしまう事例が発生しています。

リテラシーの低い利用者は、もっともらしい出力を無批判に信用し、自ら情報源となってしまいます。

この連鎖が繰り返されると、インターネット上に真偽不明のノイズ情報が溢れ返る事態に陥ります。

社会全体の意思決定が歪められ、正確な一次情報に辿り着くことが極めて困難な環境が構築されます。

ゆえに、情報を扱う個人がツールの限界を理解し、正確性を担保する最後の砦として機能すべきです。

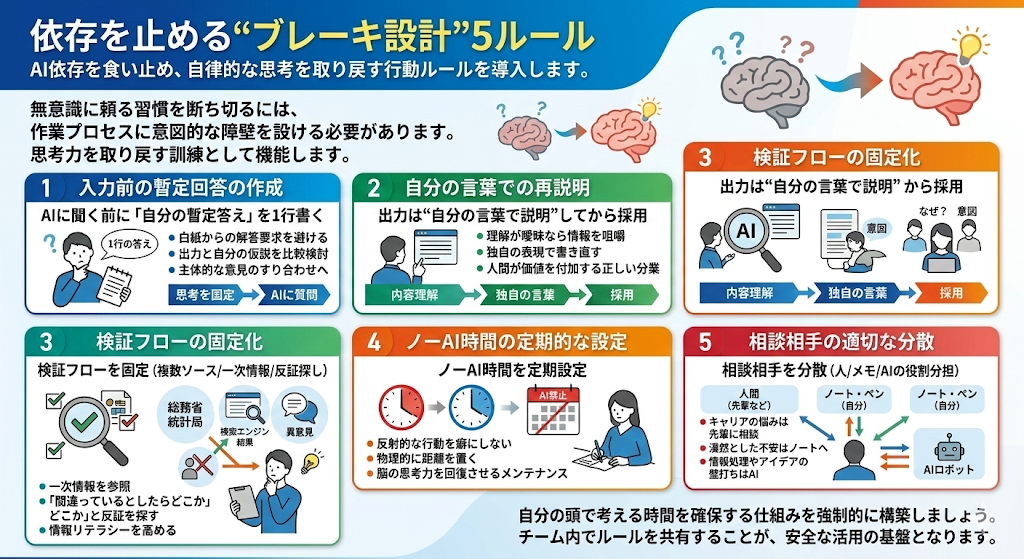

依存を止める“ブレーキ設計”5ルール

AI依存を食い止め、自律的な思考を取り戻す行動ルールを導入します。

無意識に頼る習慣を断ち切るには、作業プロセスに意図的な障壁を設ける必要があります。

ルールは脳に負荷をかけ、主体性を回復させるための訓練として機能します。

失われた思考力や検証能力も、継続的な実践によって取り戻すことが可能です。

自分の頭で考える時間を確保する仕組みを強制的に構築しましょう。

チーム内でルールを共有することが、安全な活用の基盤となります。

以下の五つのルールを日常の作業に組み込んでください。

- 入力前の暫定回答の作成

- 自分の言葉での再説明

- 検証フローの固定化

- ノーAI時間の定期的な設定

- 相談相手の適切な分散

AIに聞く前に「自分の暫定答え」を1行書く

AIへ入力する前に、自分の頭で考えた暫定的な答えを1行だけでも書き出すルールを設けます。

白紙の状態で解答を要求すると、ツールの出力に思考が引きずられ、独自の視点を持てなくなるからです。

例えば施策のアイデアを求める際、「SNSを活用した集客」という仮説をメモしてから質問を投げかけます。

事前に自分の考えを言語化しておくことで、出力結果と自分の仮説を比較検討する視点が生まれます。

出力内容が仮説を裏付けるものか、反証するものかを分析するプロセスが思考力を鍛えます。

この工程を挟むだけで、受動的な情報収集から主体的な意見のすり合わせへと作業の質が変化します。

したがって、ツールを起動する前に必ずメモを使い、自分の初期思考を固定する手順を徹底してください。

出力は“自分の言葉で説明”してから採用

AIが生成した文章やコードは、必ず自分の言葉で第三者に説明できるレベルまで理解してから採用します。

文字列をただコピーするだけの作業では、内容の正確性や文脈の妥当性を評価できないからです。

例えば構成案を作成させた場合、なぜその順番が最適なのか、各項目の意図を自分の言葉で説明できるか確認します。

理解が曖昧で説明に詰まる箇所があれば、情報を咀嚼できていない証拠であり、そのまま提出すべきではありません。

独自の表現を使って書き直す工程を経ることで、出力された情報は初めて自分の知識として定着します。

このプロセスを通じて、生成物を素材として扱い、人間が価値を付加する正しい分業体制が構築されます。

そのため、成果物を提出する前には、内容を頭の中でプレゼンテーションする自己確認の時間を確保すべきです。

検証フローを固定(複数ソース/一次情報/反証探し)

データを扱う際は、一次情報を参照し、反証を探す固定の検証フローを実行します。

AIは事実と異なる嘘を出力する可能性があり、単一の情報源として盲信する行為は極めて危険だからです。

例えば日本の人口統計を得た場合、総務省統計局の公式サイト(https://www.stat.go.jp/)にアクセスして正確性を確認します。

さらに、「この情報が間違っているとしたらどこか」という反証を探す批判的な視点を持つことが重要です。

検索エンジンを駆使して異なる見解を読み比べ、情報の妥当性を評価する工程を省略してはいけません。

検証のルーティン化は誤情報の拡散を防ぎ、情報リテラシーを高める効果をもたらします。

したがって、一次情報の確認と反証の探索をセットにした手順を定型化し、例外なく適用しましょう。

ノーAI時間を定期設定

業務スケジュールの中に、AIツールを一切使用しない時間を意図的に組み込んで作業環境を制限します。

常にアクセスできる状態だと、思考に行き詰まった際、すぐに答えを求める反射的な行動が癖になるからです。

例えば午前中の2時間はブラウザを閉じ、ノートとペンだけで企画の骨組みを考える時間に充てます。

物理的に距離を置くことで、自力で問題に向き合い、論理を組み立てる脳の持久力を鍛え直すことができます。

作業が進まずストレスを感じても、脳の思考力が回復している正常な反応に他なりません。

定期的な接続の遮断が、健全な認知機能を維持するための重要なメンテナンスとして機能します。

ゆえに、スケジュール帳に禁止タイムを明記し、自らの意思で環境をコントロールする習慣を確立してください。

相談相手を分散(人/メモ/AIの役割分担)

課題に直面した際の相談窓口をAIに絞らず、人間、メモ、ツールの三つに分散して役割を明確に分担します。

悩みを機械に委ねると、他者の感情を推し量る共感力や、自己内省によって深い気づきを得る機会が失われるからです。

例えばコードのエラーはAIに聞き、キャリアの悩みは先輩に相談し、漠然とした不安はノートに書き出して整理します。

人間との対話は予期せぬ視点をもたらし、メモ書きは自分の内面と深く向き合うための優れた手段となります。

特性を理解して使い分けることで、多角的なアプローチで問題解決を図る柔軟な思考力が養われます。

ツールは情報処理やアイデアの壁打ち相手として、得意領域に限定して活用すべき対象です。

したがって、疑問が浮かんだ際は「これは誰に相談すべき案件か」を立ち止まって考える習慣をつけましょう。

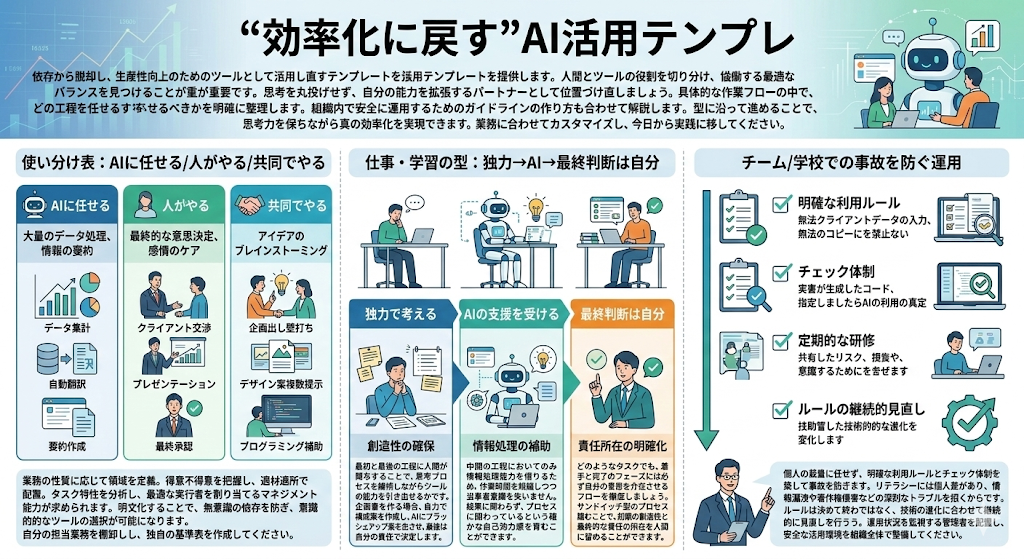

“効率化に戻す”AI活用テンプレ

依存から脱却し、生産性向上のためのツールとして活用し直すテンプレートを提供します。

人間とツールの役割を切り分け、協働する最適なバランスを見つけることが重要です。

思考を丸投げせず、自分の能力を拡張するパートナーとして位置づけ直しましょう。

具体的な作業フローの中で、どの工程を任せるべきかを明確に整理します。

組織内で安全に運用するためのガイドラインの作り方も合わせて解説します。

型に沿って進めることで、思考力を保ちながら真の効率化を実現できます。

業務に合わせてカスタマイズし、今日から実践に移してください。

| 分類 | 作業内容 |

| AIに任せる | 大量のデータ処理、情報の要約 |

| 人がやる | 最終的な意思決定、感情のケア |

| 共同でやる | アイデアのブレインストーミング |

使い分け表:AIに任せる/人がやる/共同でやる

業務の性質に応じて、AIに任せる領域、人間が責任を持つ領域、共同で進める領域を定義して使い分けます。

得意分野と不得意分野を把握し、適材適所で配置しなければ、業務の品質低下や重大なミスに繋がるからです。

例えばデータ集計はAIに任せ、クライアントとの関係構築や最終決定は人間が担うという線引きを行います。

アイデア出しなど発散と収束が必要な工程は、人間とツールが共同で壁打ちしながら進めるのが効果的です。

すべてのタスクを一律に投げ込まず、作業の特性を分析して最適な実行者を割り当てるマネジメント能力が求められます。

使い分けを明文化することで、無意識の依存を防ぎ、意識的なツールの選択が可能になります。

したがって、自分の担当業務を棚卸しし、三つのカテゴリーに分類した独自の基準表を作成してください。

仕事・学習の型:独力→AI→最終判断は自分

作業を進める際、「独力で考える、次にAIの支援を受ける、そして最終判断は自分」という型を厳守します。

最初と最後の工程に人間が関与することで、思考プロセスを維持しながらツールの能力を引き出せるからです。

例えば企画書を作る場合、自力で構成案を作成し、AIにブラッシュアップ案を出させ、最後は自分の責任で決定します。

このサンドイッチ型のプロセスを踏むことで、初期の創造性と最終的な責任の所在を人間に留めることができます。

中間の工程においてのみ情報処理能力を借りるため、作業時間を短縮しつつ当事者意識を失いません。

結果に関わらず、プロセスに関わっているという確かな自己効力感を育むことができます。

ゆえに、どのようなタスクでも、着手と完了のフェーズには必ず自分の意思を介在させるフローを徹底しましょう。

チーム/学校での事故を防ぐ運用

組織や教育現場で導入する際は、個人の裁量に任せず、明確な利用ルールとチェック体制を構築して事故を防ぎます。

リテラシーには個人差があり、基準を持たない運用は、情報漏洩や著作権侵害などの深刻なトラブルを招くからです。

例えば社内利用では顧客データの入力を禁止し、生成されたコードは必ず別の人間がレビューする体制を敷きます。

学校においても、レポートの丸写しを禁止し、補助として使った事実を明記させるルールが必要です。

定期的な研修を実施してリスクを共有し、組織全体の意識を底上げする取り組みが欠かせません。

ルールは決めて終わりではなく、技術の進化に合わせて継続的に見直しを行う必要があります。

したがって、運用状況を監視する管理者を配置し、安全な活用環境を組織全体で整備してください。

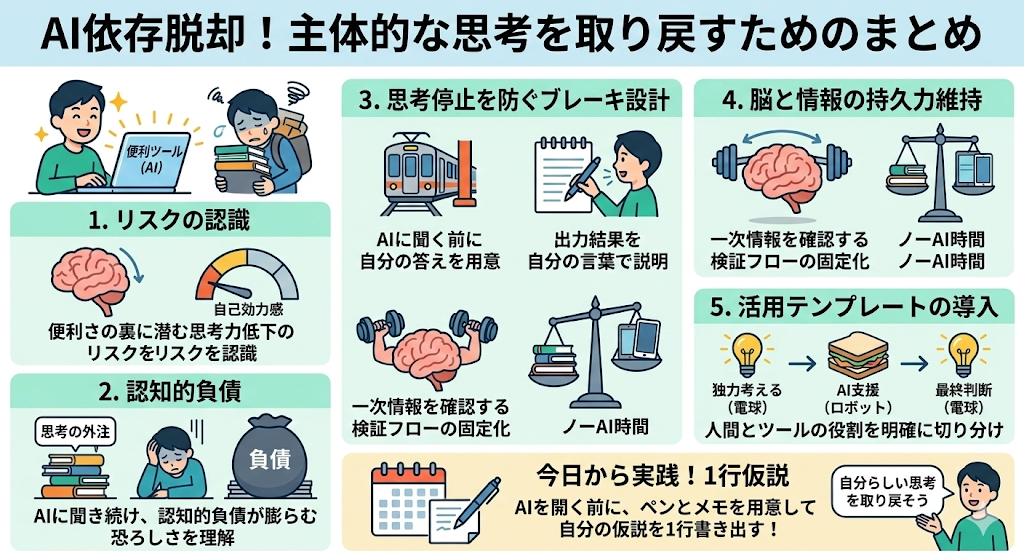

まとめ

本記事では、AI依存の仕組みと、主体的な思考を取り戻すための具体的な対策について解説しました。

便利さの裏に潜む思考力や自己効力感の低下といったリスクを認識することは、健全な活用の第一歩です。

セルフチェックを通じて自身の依存度を把握し、思考を外注し続ける認知的負債の恐ろしさを理解できたはずです。

AIに聞く前に自分の答えを用意する、出力結果は自分の言葉で説明するといったブレーキ設計が、思考停止を防ぐ鍵となります。

さらに、一次情報を確認する検証フローの固定化や、ノーAI時間の確保により、情報リテラシーと脳の持久力を維持できます。

人間とツールの役割を明確に切り分け、独力とAI支援をサンドイッチする活用テンプレートを業務に導入しましょう。

まずは本日から、AIを開く前にペンとメモ帳を用意して自分の仮説を1行書き出すルールを実践し、自分らしい思考を取り戻してください。

コメント

coworking cost coworking space price

пожарная сигнализация пожарная сигнализация установка

готовый комплект видеонаблюдения на 4 камеры wi fi комплект камеры видеонаблюдения

Популярний український журнал Різні публікує різноманітний контент: культура, стиль, суспільство та лайфстайл. Дізнавайтеся більше і знаходьте нові ідеї щодня

Журнал станкоинструмент https://www.stankoinstrument.su технологии, станки, инструменты и развитие промышленности. Полезные статьи, интервью и экспертные мнения

Лучшее прямо здесь: https://buysit.ru

Hacen prestamos a monotributistas. Sin IIBB ni balance. Solo tu DNI.

Экскурсовод предложит частный тур Калининград индивидуальные экскурсии цены с осмотром достопримечательностей и профессиональным сопровождением.

Нужен займ? https://buhgalter-uslugi-moskva.ru мгновенное решение, перевод средств и минимум требований. Идеально для срочных финансовых ситуаций и быстрых расходов

Нужен эвакуатор? эвакуатор заказать недорого в солнечногорске быстрая помощь на дороге 24/7. Перевозка автомобилей любой сложности, доступные цены и оперативный выезд по городу и области

Сломалась машина? эвакуатор дешево в химках вызвать круглосуточная работа, быстрый приезд и аккуратная транспортировка авто. Помощь при ДТП, поломках и срочных ситуациях

Нужна эвакуация машины? вызвать эвакуатор в зеленограде поблизости быстрое реагирование, аккуратная погрузка и безопасная доставка автомобиля в нужное место

Быстая эвакуация машины эвакуатор быстро быстро и удобно. Круглосуточный сервис, опытные специалисты и надежная транспортировка автомобиля

Наша топливная карта позволит эффективно контролировать бюджет и получать детальные отчеты о расходах на ГСМ. Компания «Совнефтегаз» предоставляет современные решения для заправки.

Портал для туристов https://aliana.com.ua для путешественников: направления, маршруты, советы и лайфхаки. Подбор отелей, билетов и экскурсий, идеи для отдыха и полезные рекомендации. Планируйте поездки легко и открывайте новые страны с комфортом.

Актуальний сучасний український журнал Різні це джерело натхнення, новин і корисних матеріалів. Читайте статті про життя, тренди та розвиток у зручному форматі

BCLUB https://https-bclub.tk

Нужны срочно деньги? микрозайм на 6 месяцев подайте заявку онлайн и получите деньги в кратчайшие сроки с прозрачными условиями и удобным погашением

Если вам нужна профессиональная верификация GMB в условиях российских ограничений — обратитесь к специалисту напрямую.

Top-rated dealer reddit aged account has been serving the media buying community since 2020 with consistent product quality and responsive customer support. Product cards display exact specifications including account age, verification level, included assets, geo origin, and current stock availability. Invest in verified account infrastructure and redirect the time saved from troubleshooting into actual campaign optimization work.

Leading store discord upload limit nitro gives media buyers access to aged, warmed, and verified profiles sorted by geo, trust level, and ad readiness. The knowledge base includes working guides for account warming, ad launch protocols, and reinstatement check procedures for reference. Join thousands of satisfied advertisers who source their campaign infrastructure from a verified and trusted marketplace.

Quality-focused marketplace bm fb runs multi-step verification on every listing before it reaches the catalog to protect buyer interests. Step-by-step documentation accompanies every order, covering login procedure, security setup, and recommended first actions after access. Professional media buying starts with professional tools — source from a marketplace built by advertisers, for advertisers.

Certified platform media buying field notes tracks account health metrics proactively and notifies buyers of any status changes during the guarantee period. Product cards display exact specifications including account age, verification level, included assets, geo origin, and current stock availability. Scale your advertising operations on a foundation of quality — verified profiles, complete credentials, and expert operational support.

Premium marketplace buy facebook ads threshold accounts features an extensive inventory updated daily across all major geos including USA, Europe, and Asia-Pacific regions. Step-by-step documentation accompanies every order, covering login procedure, security setup, and recommended first actions after access. The most successful media buying teams share one trait: they invest in quality infrastructure before they invest in ad spend.

Certified platform rare discord account tracks account health metrics proactively and notifies buyers of any status changes during the guarantee period. A loyalty program with cashback on every order makes repeated purchases more cost-effective for teams with regular sourcing requirements. Professional media buying starts with professional tools Ч source from a marketplace built by advertisers, for advertisers.

Магазин бытовой химии https://bytovaya-sfera.ru большой выбор средств для уборки, стирки и ухода за домом. Качественная продукция, доступные цены и быстрая доставка

Срочный онлайн займ где взять 1000 рублей срочно быстрое решение финансовых вопросов. Оформление за несколько минут, высокий шанс одобрения и перевод денег на карту без лишних документов

Все подробности по ссылке: https://avantum-remont.ru

Полная версия по ссылке: https://regalbuild.ru

Портал об автомобилях https://autort.ru новости автопрома, обзоры моделей, тест-драйвы и советы по выбору. Актуальная информация для водителей и автолюбителей

Мировые новости https://vse-novosti.net актуальные события со всего мира: политика, экономика, технологии и общество. Оперативные обновления и проверенная информация каждый день

Женский журнал https://justwoman.club онлайн: мода, красота, здоровье и отношения. Актуальные статьи, советы экспертов и идеи для вдохновения каждый день

Актуальные новости мира https://tovarpost.ru оперативная информация, аналитика и обзоры. Узнавайте о главных событиях и трендах международной повестки

Медицинский портал https://vet-com.ru о здоровье: симптомы, методы лечения и профилактика. Достоверная информация и рекомендации для всей семьи

Автомобильный портал https://avtomechanic.ru ремонт, обслуживание и диагностика. Практические советы, лайфхаки и полезная информация для водителей

Всё об автомобилях https://web-mechanic.ru на одном портале: характеристики, сравнения, рейтинги и рекомендации. Узнайте больше о новых и популярных авто

Актуальные новости https://komputer-nn.ru технологий: ИИ, программное обеспечение, смартфоны, планшеты и гаджеты. Свежие обзоры, аналитика и главные события IT-сферы

Женский портал https://cosmoreviews.club мода, красота, здоровье и отношения. Полезные статьи, советы экспертов и идеи для вдохновения каждый день

Всё для сада https://ogorodik66.ru и огорода на одном сайте: парники, теплицы, выращивание и уход. Практичные рекомендации и полезные материалы для дачников

изготовление мебели на заказ по размерам мебель индивидуальная на заказ недорого

Хочешь обучаться? складчина курсов сервис для поиска выгодных предложений на обучение. Получайте знания легально и экономьте на образовании

шкаф на заказ изготовить шкаф на заказ

шкафы на заказ шкаф на заказ купить

Предлагаем купить щебень https://sheben23.ru и песок в Краснодаре с доставкой. В наличии любые фракции щебня для строительства, бетона и дорог. Качество по ГОСТ. Доставляем собственными самосвалами быстро и без переплат.

ToLife designs https://tolifedehumidifier.com and manufactures compact dehumidifiers for residential use. The product line is based on semiconductor condensation technology and includes models with automatic shut-off, sleep mode, removable water tanks, and ambient lighting. Specifications and documentation are available on the official website.

вот тут https://forum-info.ru обсуждают похожие ситуации, можно почитать отзывы и понять, как действуют дальше

шкаф на заказ дешево шкафы-заказать.рф

Хочешь отдохнуть? день рождения в воронеже уютный отдых за городом. Комфортные дома, природа, удобства и выгодные цены для выходных и праздников

эвакуатор дешево дешево эвакуатор московский

эвакуация машин заказать эвакуатор дешево эвакуатор

Хочешь отдохнуть? аренда домиков в воронеже уютный отдых за городом. Комфортные дома, природа, удобства и выгодные цены для выходных и праздников

Нужна стальная лента? бандажная лента для глушителя широкий ассортимент, разные толщины и марки стали. Выгодные цены, быстрая отгрузка и поставки для производства и строительства

Нужна стальная лента? гост 3560 73 лента стальная упаковочная широкий ассортимент, разные толщины и марки стали. Выгодные цены, быстрая отгрузка и поставки для производства и строительства

Журнал по станкоинструментальной https://www.stankoinstrument.su промышленности: аналитика, научные разработки и практические рекомендации для развития отрасли

взять займ 5000 https://buhgalter-uslugi-moskva.ru

Нужны растения? купить саженцы в новосибирске широкий выбор саженцев, деревьев и кустарников для сада и участка. Качественный посадочный материал, консультации и удобная доставка

Читайте найсвіжіші новини https://vikka.net ексклюзивні відео, аналітику та цікаві історії. Оперативна інформація щодня!

Міський портал Ваш провідник у житті Кривого Рогу: афіша, новини, довідник та корисні сервіси для мешканців та туристів

Если вам нужна профессиональная верификация GMB в условиях российских ограничений — обратитесь к специалисту напрямую.

лучшие сериалы онлайн сериал сверхъестественное лучше смотреть

смотреть сериалы онлайн сверхъестественное смотреть бесплатно в хорошем

комплект видеонаблюдения wi fi комплект камер видеонаблюдения дома

стоматология москва стоматология на карте

дизайнерские светильники купить дизайнерские светильники овальные

купить кабель цены https://kabel-cena-za-metr-1.ru

светильники иркутск https://svetotekhnika-1.ru

стоматология на карте эстетическая стоматология

заказ свадьбы москва провести свадьбу москва

организация свадьбы ключ организация мероприятий свадьбы

заказ свадьбы москва свадьба в москве недорого

помощь в организации свадьбы организация свадьбы москва под ключ

организация свадеб услуги организация дня свадьбы

Научно-технический журнал https://www.stankoinstrument.su о станкоинструментальной отрасли. В издании рассматриваются современные технологии машиностроения, развитие оборудования, инструментов и производственных систем. Публикуются исследования учёных, опыт предприятий и решения для повышения эффективности промышленности.

Срочные деньги взять займ 30000 минимум документов, быстрое рассмотрение заявки и перевод средств напрямую на банковскую карту. Удобный способ получить деньги срочно на любые цели без посещения офиса и длительных проверок.

стоматология цены эстетическая стоматология

лента бандажная лм-50 лента стальная упаковочная мягкая

yacht charter Montenegro rent a yacht Montenegro family cruise

сайт стоматологии москва стоматология москва

лента бандажная для сип лента бандажная для сип

Milo prestamos para carpinterГa de aluminio. Aberturas modernas con poco capital.

Женский портал https://secretlady.ru о красоте, здоровье, моде и отношениях. Полезные советы, статьи о стиле жизни, уходе за собой, семье и карьере. Актуальные тренды, рекомендации экспертов и вдохновение для современных женщин.

Condition importance: knowing how to sell a used book on amazon accurately prevents returns and negative feedback – be conservative with condition ratings.

If you trade after work, the best use of best crypto signals is confirmation, not blind copying. I like checking whether their idea matches my own market view before entering. If the signal lines up with support, resistance, or momentum, I feel more confident. I’d rather miss one trade than enter late and ruin the risk setup.

Artisan platform: learning how to sell on amazon handmade requires approval process – demonstrate authentic handcrafted production.

The group I trust most would show proof, I prefer channels that focus on BTC, ETH, and high-liquidity coins. Low-cap pumps can look profitable but are much harder to enter and exit cleanly. Liquidity matters a lot when you trade with real money. For me, that is one sign of best crypto signals

Trusted dealer 14-day BM hardening delivers credentials instantly via the buyer dashboard. Cryptocurrency clears in one to two minutes; cards within five.

Resource centre Bidsignal spending history accounts consolidates the questions buyers ask most often, with answers drawn from comment-section feedback over the past quarter.

Premium catalog 21-day google ads warm-up protocol stocks aged, verified and pre-warmed configurations across the major ad platforms. Each listing carries documented spend history where applicable.

промокод в приложении пятерочка промокоды пятерочка доставка

Field reference BM5 vs BM9 BM Ledger explains the operational steps that take a fresh account from delivery to first campaign without triggering automated review.

Buying guide aged tiktok BC stock walks through the configuration matrix that matches account tier to vertical risk. Updated quarterly with field data.

[url=https://smm-nakrutka-2.ru]smm nakrutka[/url]

1010Betapp is my favourite gambling app for those long commutes! Easy to access, not bad for promotions either. Check it out at 1010betapp!

Heard Bggbetplataforma has some unique betting options. Will take a closer look this weekend! Let me see what it is: bggbetplataforma

Just gave 7777betapp a whirl. Pretty slick interface, easy to get around. Odds seem fair enough. Could use a few more niche sports, but overall, nothin’ to complain about. Def worth checking out! Click here: 7777betapp

[url=https://membrannaya-krovlya-montazh.ru]мембранная кровля[/url]

новости россии читать бесплатно новости пенсионной реформы

ftxw0z

под землей турецкий сериал смотреть онлайн безумная дорога

далеке місто в потерянных землях

фільм кіка кіно онлайн

надприродне 1 сезон нюрнберг 2025

машина стиральная ремонт сервисный центр ремонт стиральных машин

Interested in UFC? https://ufc-white-house.com unique mixed martial arts tournament will take place on June 14, 2026, in Washington, D.C., on the South Lawn of the White House. It will be the first professional sporting event in history to be held directly on the grounds of the U.S. presidential residence.

Индивидуальные поездки с гидом Калининград индивидуальные экскурсии на Куршскую косу откроют природные достопримечательности в комфортном формате путешествия.

наруто смотреть качестве онлайн наруто

Online shoppers often look for platforms that reduce complexity and allow them to enjoy browsing as a relaxing daily activity Stress free shop zone – offering a calm and easy to use interface where users can explore different products while experiencing a smooth and uninterrupted shopping journey online.

While browsing inspiration and idea discovery websites, I discovered smart discovery hub – The website had a clean and modern design, making it enjoyable to explore while everything felt well organized and thoughtfully presented throughout different sections.

During an online search for clothing fashion ideas, I discovered creative style clothing hub – The platform delivers a really nice fashion selection and smooth browsing experience overall today, making browsing smooth, structured, and pleasant across all sections.

платная стоматология центр современной стоматологии

While researching development focused websites, I came across achiever’s learning space – The platform provided a smooth browsing experience with practical content designed to help individuals grow confidence and understand effective personal development strategies.

Users exploring online fashion catalogs often prioritize platforms that provide both inspiration and organized product selection for easy browsing, and a known example is Pure Fashion Gallery which is often explained as a structured browsing platform showcasing stylish apparel collections and modern outfit ideas suitable for various occasions.

While exploring online choice and variety-based platforms, I came across modern decision space – The platform delivered great selection options with easy navigation, ensuring a smooth and enjoyable browsing experience throughout all sections.

While exploring online helpful content platforms, I came across smart info hub guide – The website provided useful content and a smooth browsing experience, making navigation simple, enjoyable, and fast throughout the site.

Many budget conscious individuals depend on structured platforms that help them identify savings opportunities and compare prices efficiently across multiple online retailers Frugal Finds Board – Focuses on delivering practical savings ideas and curated deals that support users in maintaining budget friendly shopping habits without sacrificing product quality

While browsing purpose oriented online marketplaces, I found modern meaningful discovery space – The website provides a useful experience with meaningful products and clean modern layout today, making browsing structured, simple, and efficient throughout.

During a quick search for practical home products and useful daily essentials, I found myself reviewing everyday purchase hub because the store presentation looked less chaotic compared to many websites offering similar categories and random products online – The shopping environment felt convenient, straightforward, and naturally designed for comfortable browsing without unnecessary distractions everywhere.

While researching development focused websites, I came across achiever’s learning space – The platform provided a smooth browsing experience with practical content designed to help individuals grow confidence and understand effective personal development strategies.

During a casual search for community growth websites online, I discovered together future guide – The platform had engaging and helpful information, and the positive atmosphere made browsing smooth, enjoyable, and easy to explore across different sections.

While browsing online shopping value platforms, I came across daily smart value hub – The website offers good value content and helpful information, making it easy for everyday shoppers to navigate and find useful deals quickly.

Many consumers interested in efficient online browsing often choose platforms that highlight product benefits and simplify comparisons, and one example frequently referenced is Value Discovery Store – providing a streamlined shopping environment where users can evaluate different items easily and discover options that match their needs more effectively.

I spent part of the afternoon reviewing online service platforms before eventually exploring optimized ranking network because the categories looked organized logically and the information appeared easier to locate than on many complicated competitor websites currently online – The site performance remained fast and the overall atmosphere felt polished and professionally maintained during navigation.

discoverpossibility – Interesting platform offering creative ideas and practical resources for everyday inspiration online.

During an online search for motivation and growth websites, I discovered daily development space – The platform offers useful ideas and personal development focus with motivational content, making it simple, helpful, and enjoyable to navigate.

While browsing online lifestyle inspiration platforms and helpful content sites, I discovered daily inspiration guide – The website offered fresh and practical ideas, making navigation simple and enjoyable while exploring different sections filled with useful and engaging information.

When searching for affordable essentials online, it is beneficial to use platforms that regularly share discounted essentials hub updated deals, curated product lists, and simple guides that help users make informed purchasing decisions without exceeding their planned budgets across different categories online today.

After reviewing a variety of online marketplaces during my lunch break, I found myself spending extra time on convenient item selection because the layout looked practical and the category organization seemed more balanced than many cluttered websites online – The navigation experience stayed easy to follow while browsing different sections felt smooth and pleasantly straightforward overall.

While exploring various motivational and productivity focused websites during an online browsing session, I came across goal success hub – The motivating content combined with a clean design made the website enjoyable to explore regularly, offering a smooth and inspiring user experience throughout different sections.

During an online exploration of easy shopping platforms, I discovered modern favorite deals guide – The platform offers a nice store experience with simple design and useful products today, making navigation simple, clear, and enjoyable throughout.

People exploring self development strategies and productivity improvement can turn to growth focus center which offers structured insights and motivational writing – helping individuals maintain consistency while developing habits that promote long term success and a more balanced and intentional lifestyle across different personal goals.

After spending some time checking multiple digital platforms for useful information, I found myself browsing reliable online features where the structure looked balanced and the navigation process felt much easier compared to crowded websites online today – The overall experience stayed informative and the modern layout made browsing through categories simple for visitors.

While reviewing online shopping collections and trend-based websites, I found easy style hub – The structure was clear and well organized, and the navigation felt smooth and intuitive, making browsing different sections enjoyable and effortless while exploring the curated content throughout the visit.

While searching for contemporary fashion styling platforms, I discovered modern shopping style space – The website provides modern styling ideas and smooth shopping experience for visitors online, making navigation easy, clean, and visually appealing throughout.

During a casual browsing session focused on modern home design websites, I found creative living ideas space – The platform featured stylish ideas and a simple navigation structure, making the browsing experience smooth, easy, and enjoyable across multiple sections.

Many online shoppers who value consistency and ease of use often look for platforms that provide dependable service and simple navigation, and one commonly referenced example is Favorite Shop Access Point – presenting a smooth browsing experience where users can explore various everyday products with confidence while enjoying reliable checkout flow and a generally straightforward shopping environment throughout their visit.

After navigating through several online shopping pages today, I eventually visited professional dusk corner store, and the browsing felt really smooth, with organized categories and a website that appeared genuinely user friendly overall.

While exploring informational discovery platforms online, I came across daily explore space – The site offers interesting content with an engaging layout and easy browsing flow, making it smooth, enjoyable, and easy to navigate.

I recently explored different online stores with cluttered interfaces before eventually reaching organized buying options where the products looked neatly displayed and the navigation felt simpler than expected online today – The website appeared carefully maintained throughout and the overall browsing atmosphere made another visit feel likely in the future.

[url=https://shumoizolyaciya-avtomobilya-v-moskve-1.ru]шумоизоляция автомобиля в Москве[/url]

During an online session browsing minimal and simple lifestyle platforms, I found daily calm living space – Everything was organized neatly, and the website felt comfortable to browse, making the overall experience smooth and pleasant across all categories.

During my search across several digital marketplaces this afternoon, I eventually visited high quality orchard store, and the browsing experience felt really pleasant, with carefully arranged products that were easy to navigate across all sections.

Users looking for bold fashion inspiration can browse diverse modern outfit collections online bold fashion selection hub curated expressive clothing and accessories designed for standout personal style and confidence – the marketplace encourages creative exploration of fashion while supporting individuality in everyday dressing choices

While spending time online looking through inspiration resources and recommendation websites, I discovered premium idea connection – The categories were displayed in a simple and practical way, the visual presentation remained appealing, and the overall browsing process encouraged discovering more updates and useful content online.

During an online search for creative and unique idea-based websites, I discovered modern unique ideas space – The platform showcases unique items and creative ideas in a simple layout, making browsing easy, pleasant, and well organized across all sections.

After navigating through several online marketplaces today, I eventually visited professional echo crest listing, and I found it a nice website overall, where products were thoughtfully displayed and pages loaded quickly without issues.

During comparison of different online shopping experiences, I found a platform that prioritizes fast loading and structured layout, and MeadowMystic goods portal provides a smooth browsing experience overall – The interface is intuitive, pages load quickly, and everything is arranged clearly so users can find products without confusion or delay.

I had been reviewing several digital marketplaces and service platforms before eventually finding organized ecommerce center where the categories looked clearly arranged and the information felt straightforward for regular browsing online – The website provided useful content consistently while the overall browsing experience remained smooth and reliable throughout my session.

happyhomefinds.click – Great platform for home hunting, very smooth browsing experience today.

While exploring online style and fashion inspiration platforms, I found fashion elegance guide – The content was presented in a visually appealing way with clear structure, making browsing smooth, enjoyable, and easy while exploring different stylish categories and updates.

People interested in expanding their knowledge through online browsing often rely on platforms that introduce them to diverse subjects and encourage ongoing learning experiences Insight Journey Hub Knowledge Discovery Path – it provides users with simple ways to uncover new topics and keeps them motivated to explore useful information every day with ease

During a casual search for artistic inspiration and creative resources online, I discovered daily creativity guide – The website featured inspiring ideas and practical resources that made browsing enjoyable, useful, and highly engaging for people looking for fresh online inspiration.

While comparing several ecommerce stores, I noticed a platform that emphasizes clarity and structured browsing, and Emporium Frost Lane store provides a smooth browsing experience overall – The interface is simple, navigation is intuitive, and users can explore products without distractions or clutter interfering with the overall browsing flow.

I spent time browsing various online catalogs today before discovering reliable fern echo site, and I enjoyed checking this platform, where everything looked clean and navigation remained very comfortable throughout the browsing session.

While reviewing lifestyle inspiration websites online, I came across a platform that feels creative and user friendly for modern readers, and Trendy Life Inspiration delivers smooth navigation overall – The design is clean, topics are well organized, and users can easily explore stylish ideas for improving their everyday lifestyle.

While checking various online stores for practical household products earlier today, I eventually explored recommended online items because the browsing structure looked balanced and the products appeared neatly organized for regular visitors online – I enjoyed the overall experience and every page opened smoothly without confusing glitches or unexpected delays throughout my session.

While exploring several online stores and browsing different categories throughout the afternoon, I eventually came across trusted shopping portal and really appreciated how organized the sections felt, with smooth navigation and a comfortable browsing experience from beginning to end.

While exploring ecommerce catalogs, I came across a platform that feels responsive and well structured, and Mystic Meadow product hub delivers smooth performance overall – The website loads efficiently, navigation is simple, and users can move through sections easily while enjoying a clean and readable interface design.

During a casual search for organized shopping websites and helpful online resources, I came across modern deals guide – The interface looked clean and user friendly, and the information was displayed clearly across sections, creating a smooth browsing experience that felt both practical and visually appealing overall.

During an online exploration of practical content websites, I came across daily useful essentials guide – The platform delivers helpful information with an enjoyable browsing experience that feels smooth, organized, and easy to use across all pages visited.

Shoppers interested in finding uncommon deals and ideas can use everyday uniqueness portal which showcases rare and creative items helping users explore diverse options across categories – making daily shopping more exciting by introducing distinctive products that are not typically available in standard stores online.

During an online search for shopping and discovery websites, I found daily shop discovery space – The platform provides a great shopping experience with interesting finds and smooth navigation here, making the experience simple, clear, and pleasant across all sections.

While comparing online style advice platforms focused on everyday fashion improvement, I noticed a helpful and user friendly website, and Style Improvement Guide delivers a smooth browsing experience overall – The tips are simple, realistic, and designed to help users build better personal style habits step by step.

While exploring different web platforms earlier today, I came across organized echo grove collective and appreciated the helpful layout, with detailed information and browsing that stayed simple and smooth throughout the visit.

During my exploration of online retail platforms, I found a site that feels clean and easy to use, and Petal Collective urban store delivers smooth navigation overall – The layout is structured logically, products are easy to locate, and users can browse comfortably without distractions or confusing design elements interfering with usability.

During a casual search for deals and promotional websites, I discovered daily discounts space – The platform featured useful offers with clear presentation and easy browsing, making navigation simple, enjoyable, and efficient across all categories.

pixelharvest – Great looking website design here, information feels updated and naturally well presented.

During my review of digital shopping platforms, I came across a website that feels clean and efficient, and Meadow Frost Collective network offers smooth navigation overall – Pages load quickly, structure is clear, and users can browse easily without clutter or confusing interface elements.

During a casual exploration of online inspiration platforms, I came across growth action guide – The website felt motivating and practical, with ideas that encourage users to start small actions daily and steadily improve their personal and professional life routines.

During my exploration of online clothing discounts and promotions, I found a website that feels practical and engaging for fashion enthusiasts, and Daily Deals fashion portal offers a smooth browsing experience overall – Pages load quickly, products are displayed clearly, and visitors can discover affordable fashion items without cluttered visuals or confusing navigation.

I was reviewing various online stores and informational pages for quite some time today when I landed on excellent online destination, and I genuinely liked how quickly the sections responded while still presenting a very clean, modern, and professionally structured browsing experience.

While casually checking online marketplaces earlier today, I came across cleanly arranged harbor hub and found the website feels polished, with clearly organized categories and content that reads naturally throughout the platform.

While browsing style focused websites for fashion lovers, I discovered creative fashion update space – The website provides trendy styles and useful updates for modern fashion lovers today, making the experience smooth, modern, and enjoyable throughout the site.

While exploring different ecommerce platforms focused on usability and interface clarity, I found a clean and responsive design that feels easy to navigate, and Urban Petal store hub delivers a stable browsing experience overall – The website performs smoothly, pages load quickly, and navigation feels simple and intuitive, allowing users to explore products without confusion or unnecessary complexity in the interface.

Shoppers who enjoy trying new online platforms often prefer those that offer intuitive discovery features, and a commonly referenced example is Shop Discovery Experience which is described as a simple and engaging space that helps users browse various categories and uncover products that match their interests effortlessly.

While reviewing several digital growth platforms this afternoon, I eventually explored simple online resources where the information looked clearly arranged and the browsing process appeared smoother than many alternatives online currently – The platform maintained a clean user friendly structure where everything felt accessible and easy to explore during navigation.

Reading this between two meetings turned out to be the highlight of the morning, and a stop at unlocknewpotential continued that highlight quality, content that outshines the structured parts of a working day is doing something well beyond ordinary and this site has produced multiple such highlights for me already this week alone.

While exploring online motivational platforms, I found a website that feels simple and encouraging for personal growth, and Vision Matters Hub delivers a smooth browsing experience overall – The content promotes focus, self awareness, and consistent effort toward achieving meaningful goals in everyday life decisions.

While exploring online informational and idea-focused websites, I found smart insight space – The platform presented clear and engaging ideas, making browsing smooth, enjoyable, and easy while discovering different structured sections of informative content.

While analyzing ecommerce platforms for usability, I noticed a website that feels fast and visually appealing, and Frost Petal shopping hub provides a smooth browsing experience overall – The interface is modern, pages load quickly, and users can navigate without clutter or confusion affecting the experience.

While browsing online shopping outlets with minimal design, I found creative clean shopping space – The platform delivers a clean outlet experience with good selection and simple navigation online, making browsing simple, smooth, and user friendly.

pravdadaily.com.ua/chutlyvi-pryvitannia-z-dnem-narodzhennia-mami-nayteplishi-slova-dlia-liubliachoi-materi/

sofa dry cleaning dubai

During a casual search for online style collections and visually organized browsing platforms, I discovered smart style reference – The website layout appeared clean and attractive, the browsing process felt simple to understand, and the featured content created a pleasant experience for exploring different sections comfortably.

https://capital360.com.ua/

While exploring different online shopping websites this morning, I spent time on valuable petal iron hub, and it was a great browsing experience overall, with fast pages and professionally arranged products throughout the visit.

Many online shoppers looking to stretch their budgets often use curated websites that compile deals and discounts from various sources such as Savings Finder Network – it offers structured deal comparisons and helps users identify cost effective products while shopping across different categories effectively

While checking various online shopping platforms earlier today, I came across helpful oak amber store and enjoyed browsing here, where pages felt clean and loaded without delays during the entire visit.

I recently opened several online service websites before eventually exploring easy ranking platform where the categories looked neatly arranged and the navigation process felt more natural than many cluttered platforms online today – The clean interface created a positive impression and the services appeared useful for regular visitors.

Ставка на любовь – 2 сезон. Любовь, страсть и неожиданные повороты возвращаются! Новые герои, жаркие свидания и судьбоносные решения – кто рискнёт всем ради чувств? Драматичные признания, сложный выбор и финал, от которого захватывает дух. Не пропусти ни одной серии – включай прямо сейчас: шоу Ставка на любовь 2

While exploring online communities dedicated to self discipline and motivation, I found a platform that feels organized and inspiring for ambitious readers, and Reach Success network delivers a smooth browsing experience overall – The layout is simple, guidance is displayed clearly, and users can explore achievement focused ideas comfortably without distractions.

While reviewing different online shopping websites this afternoon, I visited organized pine commerce listing, and it was a helpful platform overall, with smooth navigation and information that appeared clear and easy for visitors to follow.

During an online search for fashion style stores and inspiration, I discovered modern chic fashion space – The platform offered a nice browsing experience with modern design and helpful information, making it smooth and enjoyable to explore across all categories today.

While searching for growth mindset and motivation resources online, I discovered creative daily progress space – The website provides motivational content and helpful guidance for personal progress every day, making navigation smooth, clear, and supportive throughout.

как отмыть канистру от налета и зелени пошаговая чистка канистры народные и бытовые средства простые способы

Came in expecting another generic take and got something with actual character instead, and a look at bestpickscollection carried that personality forward, finding a distinct voice on a saturated topic is impressive and worth pointing out when it happens because most sites end up sounding identical to their nearest competitors quickly.

Погружайся в захватывающие сюжеты вместе с нами! Голливудские блокбастеры, культовые сериалы, добрые мультфильмы и зрелищные премьеры – всё доступно в отличном качестве. Никакой рекламы, только чистое удовольствие от просмотра. Создай свою коллекцию любимых фильмов и наслаждайся: фильмы

Online users interested in refined fashion aesthetics often browse curated style platforms, and a commonly referenced example is Elegant Style Discovery Portal which is described as offering sophisticated outfit inspiration, trend exploration, and helpful guidance for building stylish wardrobes.

After reviewing several online marketplaces and catalogs today, I eventually found trusted mystic horizon store, and I appreciated the clean structure, where navigation worked smoothly and website performance felt reliable throughout the visit.

During an evening search for ecommerce and seller platforms, I eventually came across quality listing hub because the categories looked clean and browsing felt easier than many cluttered websites online today – The experience was pleasant and everything appeared organized and professionally maintained from start to finish.

While analyzing online shopping platforms focused on everyday trendy products, I noticed a website that feels practical and visually clean for users, and Shopping Trend Portal delivers a smooth browsing experience overall – The interface is intuitive, categories are well arranged, and users can find modern items without unnecessary complexity.

While exploring different web platforms earlier today, I came across organized amber petal collective and found everything well structured, where content is easy to understand quickly and smoothly presented throughout the experience.

While exploring several informative browsing platforms and online discovery resources during my free time recently, I came across daily inspiration source – The website offered a clean and modern appearance, helpful browsing sections, and enough interesting material to make the overall experience feel engaging and easy to navigate throughout the visit.

While exploring online networking and idea-sharing platforms, I came across smart creativity network hub – The website provides creative modern ideas and useful networking inspiration for users today, making browsing smooth, easy, and enjoyable across all pages.

During my exploration of online retail platforms, I found a website that feels modern and efficient, and PetalStore frost marketplace delivers smooth navigation overall – Pages are well structured, content is easy to read, and users can browse products comfortably without confusion or overwhelming interface complexity.

During a casual browsing session for educational platforms, I found smart knowledge guide – The platform provided useful insights and well organized content, and its clean user friendly layout made browsing smooth, enjoyable, and easy across different categories.

пк и ноутбук в чем разница между ноутбуком и компьютером

Решил воспользоваться услугой и не пожалел о выборе. Девушка выглядела привлекательно и вела себя уверенно и доброжелательно. Общение было естественным и непринуждённым. Всё прошло комфортно: шлюхи инди

In conversations about how digital stores present their inventory structures, a commonly cited illustrative example is general outlet browsing link which is usually described as a conceptual representation of e-commerce navigation systems emphasizing category clarity, product assortment visibility, and straightforward user exploration across multiple sections.

Reading this prompted a small note in my reference file, and a stop at theperfectgift prompted another, the rare site that contributes useful nuggets to my own working knowledge rather than just consuming my attention is worth the time investment many times over compared to the usual pile of forgettable scroll content.

During my exploration of idea-sharing platforms, I found a website that feels clean and motivating, and OutletPure learning space delivers a smooth browsing experience overall – The layout is well structured, content is easy to follow, and users can engage with inspiration without clutter or distractions.

I spent part of today exploring online stores and product websites before finding organized digital commerce hub, and I found the website feels modern overall, with properly arranged categories and content that reads naturally throughout the entire session.

I recently checked multiple online resource platforms before eventually landing on organized info hub where the structure appeared clean and the information felt easier to understand than several competing websites online today – The content quality stood out as strong and the platform felt useful for users looking for dependable information.

During my online browsing session this morning, I explored multiple websites before discovering quality opal collective shop, and I found a nice collection available, with browsing staying comfortable and descriptions that looked genuinely informative throughout.

During an online search for high-end luxury items, I discovered modern luxury style space – The website delivers luxury products and stylish finds in an elegant way online, making browsing smooth, sophisticated, and easy to explore.

During a casual exploration of fashion outlet websites and online style platforms, I came across modern outfit guide – The content was engaging and the layout was visually appealing, making browsing smooth and enjoyable while discovering different sections of the website.

Going to come back when I have more time to read carefully, the post deserves more than a quick scan, and a stop at discovernewhorizons reinforced that, this is the kind of site that rewards a slower read which is hard to find in this fast paced corner of the internet but really worthwhile.

Took a few notes from this post, the points are easy to remember without needing to come back and check, and a look at brightnewbeginnings added a couple more, the kind of place that sticks in the memory long after the browser tab has been closed for the day which says a lot really.

Recommended to anyone working in or curious about this area, the depth and clarity combine well, and a look at purechoiceoutlet keeps that going across more pages, the kind of site that earns regular visits rather than chasing trends has my respect because it suggests genuine commitment to the topic itself rather than to chasing trends.

Recommend this to anyone who values clear thinking over flashy presentation, and a stop at purestylemarket continued in the same understated way, this site has its priorities in the right place which makes it worth supporting through repeat visits and recommendations rather than just one passing read today before moving on quickly elsewhere.

People aiming to create meaningful change in their lives can explore growth action hub which emphasizes the importance of taking consistent steps forward, helping users develop stronger habits that lead to long term success in personal development, career advancement, and everyday productivity improvement.

Now noticing that the post avoided the temptation to be funny in places where humour would have undermined the substance, and a stop at dreambiggeralways maintained the same restraint, knowing when to be serious is a rare editorial virtue and this site has clearly developed it through what I assume is careful editorial practice over years.

During a casual session exploring inspiration and creativity websites online, I came across idea inspiration guide – The platform had a clean layout with useful information, making browsing feel engaging, smooth, and naturally motivating while exploring various creative resources and concepts.

While exploring self care and wellness resources focused on healthy growth, I found a website that feels organized and uplifting for thoughtful browsing, and Dream Wellness online delivers a smooth browsing experience overall – Featured topics are displayed clearly, navigation is intuitive, and readers can focus on supportive wellness strategies without clutter.

While searching for motivational thinking websites online, I discovered modern inspiration mindset hub – The website delivers inspired thinking and helpful ideas for personal growth journey, making navigation smooth, easy, and meaningful across all pages.

While reviewing various digital platforms, I came across a website that feels structured and dependable, and Frost Pine content collective offers a smooth browsing experience overall – The layout is minimal and clear, allowing users to browse helpful content easily without clutter or confusing design elements interfering with readability.

Honest reaction is that I want to send this to a friend who would benefit from it, and a look at createimpacttoday added more material I will pass along too, the impulse to share is the strongest signal I have for content quality and this site is generating that impulse cleanly across multiple posts.

While casually exploring ecommerce websites earlier today, I found myself reviewing quality royal marketplace because the structure looked clean and the categories appeared easier to understand than many competing sites online currently – I really appreciated the modern layout and the pages felt polished and simple to navigate throughout the experience.

During my online browsing session today, I checked multiple platforms before landing on useful petal twilight store, and everything looked organized properly, with pages opening smoothly and content staying easy to understand across all pages.

Just want to say thank you for putting this together, posts like these make searching online actually worth it sometimes, and a quick look at bestchoicecollection kept that going, useful and easy to read without any of the tricks that ruin most blog comment sections lately on the wider open web.

While searching for online creative idea and gifting platforms, I found modern ideas hub – The site presented engaging concepts in a clear structure, making browsing simple and encouraging repeat visits for updated inspiration and new gift ideas.

Took me back a step or two on an assumption I had been making, and a stop at everymomentmatters pushed that reconsideration further, writing that gently corrects the reader without being aggressive about it is a rare diplomatic skill and the team here clearly knows how to land critical points without turning readers off.

Now planning to come back when I have the right kind of attention to read carefully, and a stop at purechoiceoutlet reinforced that plan, choosing the right moment to read certain content is a quiet form of respect for the work and this site is generating those careful planning behaviours from me consistently as a reader.

Anyone interested in discovering fresh perspectives on creativity can use idea discovery platform which provides structured insights and modern inspiration – it encourages users to expand their thinking boundaries while engaging with content designed to improve innovation skills and everyday problem solving effectiveness over time.

Will be sharing this with a couple of people who care about the topic, and a stop at yourfashionoutlet added more material worth passing along, the kind of site that is generous with quality content and does not make you jump through hoops to access it which is appreciated more than the team probably realises.

While exploring online educational motivation websites, I came across smart achievement guide hub – The website delivers educational content and motivation to learn, explore, and achieve, making navigation simple, structured, and engaging throughout all pages.

While analyzing online reflection and mindfulness platforms, I noticed a website that feels intuitive and emotionally engaging for users, and Moments of Life hub delivers a smooth browsing experience overall – The interface is easy to understand, content is motivating, and readers can browse comfortably without unnecessary complexity.

While exploring multiple websites and resources during my free time today, I spent extra time browsing professional online listing because the pages loaded quickly, the layout remained easy to follow, and the content included several genuinely useful details.

Well structured and easy to read, that combination is rarer than people think, and a stop at yourstylezone confirmed the same standard runs across the rest of the site, definitely the kind of place I will be coming back to when this topic comes up in conversation later again over the weeks ahead.

While browsing different digital marketing platforms this afternoon, I eventually found reliable SEO toolkit because the layout looked structured and the navigation felt more comfortable than many cluttered websites online currently – Everything loaded without problems and the website appeared trustworthy and genuinely helpful for users overall.

I spent time browsing various online catalogs today before discovering reliable urban crest site, and I really liked exploring, as the website felt modern and browsing remained simple throughout the visit.

While browsing various design and lifestyle inspiration websites online, I came across stylish living guide – The platform had a modern layout with engaging content, making it enjoyable to navigate and explore ideas while maintaining a smooth and visually appealing browsing experience overall.

Таможенное оформление для юридических лиц в Москве и Московской области. СБ Карго – официальный таможенный представитель: подготовка документов, расчёт платежей, сопровождение импорта и экспорта, помощь в прохождении таможенных процедур без лишних рисков и задержек. Консультации для участников ВЭД: https://protamozhennoe-oformlenie.ru/

Got pulled in by the headline and stayed because the content actually delivered on the promise, and a stop at perfectbuyzone kept that trust intact, when a site lives up to its own framing it earns the right to keep showing up in my browser tabs going forward indefinitely from here on out really.

Really appreciate the lack of pop ups, modals, cookie banners stacking on top of each other, and a quick visit to purechoiceoutlet confirmed the same clean approach across the rest of the site, technical decisions about user experience are part of what makes content actually pleasant to engage with for sure.

This actually answered the question I had been searching for, and after I checked perfectbuyzone I had a few more pieces I had not realised I needed, that is the sign of a site that knows what its readers want before they even know how to ask it which is impressive.

Just nice to read something that does not feel like it was assembled from a content brief, and a stop at dreambiggeralways kept that handcrafted feel going, you can tell when a real human with real understanding is behind the words versus a templated piece churned out for an algorithm to find.

Now thinking I want more sites built on this kind of editorial foundation, and a stop at purestylemarket extended that wish into a broader hope, sites built on substance and care rather than on metrics and growth are the kind of sites I want to see more of and this one is a small example worth supporting.

While browsing online fashion websites and style guides, I found smart style space – The website featured stylish content and simple navigation, creating a smooth and enjoyable experience throughout different fashion categories.

People who enjoy browsing luxury items online can explore premium finds showcase which presents curated elegant products and stylish selections – helping users discover high quality goods that reflect refined taste exclusivity and contemporary luxury living standards for everyday inspiration and shopping needs.

Skipped the comments section but might come back to read it, and a stop at shopwithstyle hinted at a quality reader community, sites where the comments are worth reading separately from the post are increasingly rare and signal a particular kind of audience that has grown around the editorial vision over time gradually.

While browsing relaxed lifestyle shopping websites, I found smart fun shopping space – The website delivers a relaxed shopping experience with fun products and easy navigation online, making browsing simple, clean, and enjoyable throughout the site.

While exploring various modern ecommerce platforms focused on speed and clarity, I came across a clean and efficient interface that feels easy to navigate, and Frost Shore Goods hub delivers a smooth browsing experience overall – The website loads pages quickly, and the information is presented in a clear structured way that helps users browse products without confusion or unnecessary visual clutter.

During exploration of online shopping deal hubs, I found a website that feels practical and engaging for bargain hunters, and Dream savings network offers a smooth browsing experience overall – The interface is intuitive, promotions are highlighted effectively, and users can explore discounted products without unnecessary distractions.

Лучшее прямо здесь: https://slovarsbor.ru/w/%D0%BC%D0%B0%D0%BD%D0%B8%D0%B5/

Reading the writers other posts after this one suggests the quality is consistent rather than peak, and a stop at dreambiggeralways confirmed the consistent quality reading, sites that hold the same level across many pieces rather than peaking on a few are sites with sustainable editorial discipline and this one has clearly developed that.

Honestly this hits the sweet spot between detail and brevity, no rambling and no shortcuts, and a quick visit to purechoiceoutlet kept that going across the related pages, the kind of place that respects your attention without trying to grab it through cheap tactics or attention seeking design choices that get tired fast.

Thanks for the practical examples scattered through the post rather than abstract theory only, and a look at amazingdealscorner continued that grounded style, abstract points are easier to remember when paired with concrete situations and the writers here clearly understand how readers actually retain information from blog content reading sessions.

Saving the link for sure, this one is a keeper, and a look at perfectbuyzone confirmed I should bookmark the entire site rather than just this page, the consistency across what I have seen so far suggests there is a lot more here worth coming back for soon when I have more time.

Came across this and immediately thought of a friend who would enjoy it, and a stop at purestylemarket also reminded me of someone, content that triggers the urge to share is content that has earned my recommendation and this site has earned multiple from me already across different conversations during the week.

amberpetalmarket – Smooth experience overall, categories are clearly arranged and useful today.

I spent some time reviewing SEO platforms before eventually stopping at quality SEO cart hub where the interface looked organized and navigation felt smoother than many competing websites online currently – The experience was great, and browsing products and information felt simple, comfortable, and easy overall.

Comfortable reading experience throughout, no jarring tone shifts and no awkward formatting, and a look at shopwithstyle kept that smooth feel going, the kind of editorial polish that goes unnoticed when present but glaring when absent is something this site has clearly invested in across the broader content as well which deserves recognition.

Now feeling slightly more committed to my own careful reading practices having read this, and a stop at learnsomethingamazing reinforced that commitment, content that models the kind of attention it deserves is content that calibrates the reader and this site has clearly raised my own bar for what to bring to good writing today.

After opening multiple online shopping websites today, I eventually reached recommended urban fern portal, and I found a helpful platform overall, where categories were simple and product searching felt straightforward and comfortable.

If I had to summarise the editorial sensibility of this site in a few words it would be careful and human, and a look at yourpathforward extended that summary feeling, capturing the essence of a sites approach in brief is hard but this site has a clear enough identity that the summary comes naturally enough.

People who enjoy developing creative thinking skills may find value in mental spark archive which provides inspiring content and structured prompts designed to activate imagination and improve reasoning ability – helping users build a consistent mindset for innovation, reflection, and effective decision making in both personal and professional contexts.

Picked this for a morning recommendation in our company chat, and a look at yourfashionoutlet suggested I will mention this site again later, recommending content into a workplace context is a small editorial act that requires confidence in the recommendation and this site is making me confident in those recommendations consistently here too.

Looking through the archives suggests this site has been doing this for a while at this level, and a look at findsomethingamazing confirmed the long term consistency, sites that have maintained quality across years rather than just a recent stretch are sites with serious editorial discipline and this one has clearly been at it for a while.

During exploration of online shopping experiences centered on satisfaction and joy, I found a platform that feels organized and user friendly, and Joyful Cart Online provides a smooth browsing experience overall – The interface is simple, navigation is straightforward, and users can discover products that add real value and happiness.

Worth flagging that this approach to the topic is fresh without being contrarian, and a stop at bestchoicecollection extended the same fresh angle, finding original perspective on familiar subjects is rare and this site has clearly developed its own way of seeing rather than echoing the dominant takes from elsewhere consistently.

After spending time exploring several online stores and digital catalogs today, I eventually came across trusted shopping resource and genuinely appreciated how clean the structure appeared, with organized products and informative descriptions that made browsing feel simple and enjoyable throughout.

Worth pointing out that the post avoided the temptation to summarise everything at the end, and a look at findyourfocus continued that confident closing approach, content that trusts readers to retain the substance without being reminded of it at the end is content that respects the reader and this site practices that respect.

Great work on keeping things readable, the post never drags or repeats itself which I really appreciate, and a stop at thinkbigmovefast added a bit more context that fit naturally with what was already said here, no need to read everything twice to get the point being made today.

During an online session browsing shopping and product trend websites, I came across featured deals hub – The platform offered several interesting products in an organized way, making browsing enjoyable and giving the impression that it is worth visiting again soon.

Closed the laptop and walked away thinking about the post for a good twenty minutes, and a stop at everydayfindsmarket produced similar lingering thoughts, content that survives the closing of the browser tab is content that has actually entered the mind rather than just decorating the screen for the duration of the reading.

Now feeling slightly more committed to my own careful reading practices having read this, and a stop at learnsomethingamazing reinforced that commitment, content that models the kind of attention it deserves is content that calibrates the reader and this site has clearly raised my own bar for what to bring to good writing today.

During a late evening search for online information and update platforms, I eventually came across trusted update collection because the structure looked clean and browsing felt more stable than several alternatives online currently – I found interesting updates and the overall design felt visually balanced and easy to explore.

Liked the balance between depth and brevity, never too shallow and never too long, and a stop at trendforlife kept the same balance going across the rest of the site, this is one of the harder skills in writing and the team here clearly has it figured out very well indeed across every page.

A piece that earned its conclusions through the body rather than asserting them at the end, and a look at yourstylezone maintained the same earned quality, conclusions that follow from what came before are more persuasive than declarations and this site has clearly internalised that principle in how it constructs arguments throughout pieces.

In my recent search for trustworthy online shopping platforms that offer a wide range of curated items, I discovered Amber Ridge marketplace overview – and found it reasonably well-structured; browsing feels intuitive, and the product organization helps users quickly locate items without unnecessary distractions or slow loading sections.

Started forming counter examples to test the claims and the post handled most of them implicitly, and a look at fashiondailydeals continued that anticipatory style, writers who think two steps ahead of the critical reader save themselves from a lot of follow up work and this writer has clearly internalised that habit consistently.

Honest assessment is that this is one of the better short reads I have had this week, and a look at dailyshoppingzone reinforced that, the bar for short content is low because most of it sacrifices substance for brevity but this site manages both at once which is harder than it sounds for most writers attempting it.

People looking to improve their academic direction and personal development can use study progression hub which provides organized learning content and motivational resources – supporting users in building discipline, gaining knowledge step by step, and achieving long term goals through steady and focused educational effort.

After browsing through various online marketplaces today, I eventually discovered structured urban lattice hub, and I had a good experience overall, with trustworthy information and smooth navigation throughout the platform.

Glad I gave this a chance instead of bouncing on the headline, and after modernhomecorner I was certain I had made the right call, snap judgements based on titles miss a lot of good content and this is a reminder to slow down and check things out before scrolling past in a hurry.

Reading this confirmed a small detail I had been uncertain about, and a stop at modernideasnetwork provided the source for further checking, content that supports verification through citations or links rather than just asserting facts is more trustworthy and this site has clearly built its credibility through that kind of verifiable approach consistently.

During my exploration of service-based online platforms, I found a site that feels structured and fast, and BoostWeb digital hub delivers smooth navigation overall – Content is clearly presented, interface is intuitive, and users can access services without unnecessary complexity or distractions.

While exploring inspirational and motivational platforms online, I came across modern inspiration space – The site had a positive atmosphere and inspiring content, making it stand out nicely and ensuring a smooth and engaging browsing experience overall.

Decided to subscribe to the RSS feed if there is one, and a stop at findyourowngrowth confirmed that decision, content that I want delivered to me proactively rather than just remembered when I have time is content that has earned a higher level of commitment from me as a reader looking for reliable sources.

During my exploration of online innovation platforms, I found a website that feels organized and practical, and Future Builders portal delivers smooth navigation overall – Pages load quickly, information is easy to follow, and users can focus on learning and growth without clutter or overwhelming interface elements affecting usability.

Honest reaction is that I want to send this to a friend who would benefit from it, and a look at urbanfashioncorner added more material I will pass along too, the impulse to share is the strongest signal I have for content quality and this site is generating that impulse cleanly across multiple posts.